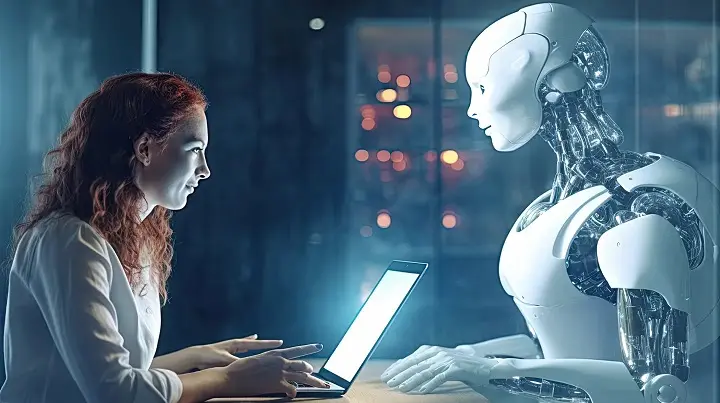

ChatGPT volvió al centro de la escena en las últimas semanas en el debate sobre la inteligencia artificial al darse a conocer un hackeo que involucró a cientos de cuentas en la plataforma.

El ataque se dio mediante el uso de distintos programas malware que accedieron a la información de usuarios particulares.

A raíz de este incidente, la cuestión de la privacidad y la protección de los datos privados en la herramienta de inteligencia artificial desarrollada por OpenAI fue puesta de manifiesto por la comunidad de internautas: ¿Es seguro usar el motor de lenguaje generativo?

Como la versión gratuita de ChatGPT no se conecta a internet, la mayoría de usuarios utiliza la herramienta con demasiada confianza y cree que lo que se ingresa en la conversación con la IA se pierde o desaparece cuando cierra la sesión.

Sin embargo, esto no es así.

Para usar ChatGPT hay que crear una cuenta e ingresar con una contraseña.

Así, todo lo que le preguntamos o conversamos con el bot de inteligencia artificial queda registrado en el historial.

Por más que esa información no se comparte en internet, ni sirve para que el bot aprenda, se mantiene guardada en los servidores de OpenAI.

En el hackeo ocurrido hace semanas, los piratas informáticos accedieron a esa información de más de 100 cuentas.

Por esa razón, para evitar que nuestros datos puedan caer en manos equivocadas, es mejor prevenir.

Por esa razón te compartimos qué cuatro datos no tenés que compartir nunca con el bot de ChatGPT:

Datos personales y contraseñas

Nunca compartas con la inteligencia artificial tu nombre completo, direcciones de lugares que frecuentás, número de documento o pasaporte, nombres de tu familia, compañeros de trabajo u otra información sensible y privada.

Y por supuesto, jamás ingreses las contraseñas de tus perfiles en redes sociales y credenciales de acceso a sitios, especialmente de homebanking.

Información financiera

Nunca le digas a ChatGPT ni ninguna herramienta e IA, los números de tu tarjeta de crédito, cuenta bancaria, detalles de tus inversiones o transacciones.

Leé también: Bard vs. ChatGPT: para qué es mejor cada chatbot de inteligencia artificial y cuáles son sus debilidades

Datos de salud sensibles

Es aconsejable evitar dar a conocer información médica confidencial.

Los diagnósticos, resultados de estudios o historial médico son documentos privados y no deben ser compartidos.

Información personal de terceros

Respetar la privacidad de otras personas es tan importante como la propia. Por eso hay que evitar ingresar en la base de datos de la inteligencia artificial información personal de terceros sin su consentimiento.

Esto significa no compartir nombres, direcciones, números de teléfono o cualquier otro detalle íntimo de otras personas. /TN